在人工智能领域,一场关于推理经济的变革正悄然重塑产业格局。当行业焦点从训练大模型转向大规模推理应用时,一个关键结论逐渐清晰:未来AI竞争的核心不在于谁拥有最强大的训练芯片,而在于谁能以最低成本稳定供应推理算力。这种转变正在引发全球科技巨头的战略调整,中国厂商更是在这场变革中找到了独特的突破口。

阿里巴巴近期的一系列组织架构调整印证了这一趋势。该集团新成立的技术委员会中,推理平台负责人吴泽明被赋予日常调度权,统筹模型、基础设施与商业化落地。与此同时,新组建的Alibaba Token Hub事业群明确要求所有关联业务围绕Token消耗场景展开,这标志着中国科技巨头首次将推理经济提升到战略高度。与阿里巴巴遥相呼应的是,英伟达CEO黄仁勋在GTC 2026大会上提出"Token工厂经济学",将数据中心定义为生产Token的工厂,并预言工程师薪酬将包含Token配额。

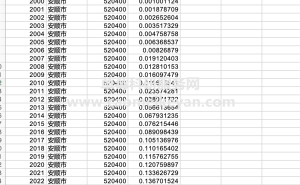

推理成本的断崖式下跌为这场变革提供了经济基础。根据a16z的研究,同等性能的模型推理成本每年下降约10倍,GPT-3水平的服务价格从2021年的每百万Token 60美元暴跌至2024年的0.06美元。英伟达最新发布的Blackwell平台将推理成本较前代降低10倍,2026年量产的Vera Rubin平台更承诺再降一个数量级。这种成本下降趋势与Agent技术的爆发形成奇妙共振——OpenRouter平台数据显示,2026年初Agent类应用的周度Token调用量出现翻倍增长,单个工作流消耗的Token数量较传统聊天机器人提升百倍以上。

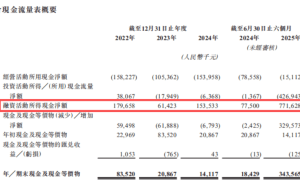

当Token价格下降三个数量级与消耗量上升三个数量级形成对冲,企业AI总支出不降反升。这种悖论揭示出推理经济的新逻辑:就像工厂不会因电价下降而减少用电,企业正在用更多Token支撑更复杂的AI应用。AWS、谷歌等云服务商纷纷推出专用推理芯片,Google TPU v6e甚至帮助Midjourney将月支出从210万美元压缩至70万美元。所有迹象表明,推理算力正从成本项转变为核心基础设施开支。

在这场全球竞赛中,中国展现出独特的竞争优势。美国对华AI芯片管制主要针对训练场景,通过限制算力密度、互联带宽和先进制程等手段卡住大模型训练的脖子。但推理场景对峰值算力的要求远低于训练,更看重吞吐量、延迟和能效比等指标。这种差异为国产芯片开辟了非对称竞争赛道——当训练芯片受制于7nm以下先进制程时,推理芯片在14nm乃至28nm制程上就能实现可观性能,而中国在这些成熟制程上已建立完整产业链。

行业观察家指出,推理经济的崛起正在重构AI产业利润分配方式。当训练成为一次性资本支出,推理则转化为持续运营成本,掌握推理算力定价权的企业将主导未来市场。这种转变对中国尤为有利——在训练芯片受限的背景下,国产芯片厂商可通过专注推理场景实现弯道超车,而中国庞大的应用市场和丰富的场景需求,则为推理经济提供了最肥沃的土壤。