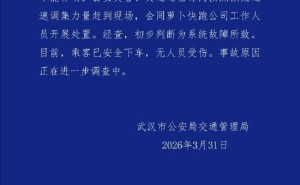

据科技媒体macworld与mashable联合披露,苹果公司正在对智能语音助手Siri进行自2011年诞生以来最重大的技术革新。此次升级将彻底改变Siri仅能处理单一指令的现状,通过底层架构重构实现多任务协同处理能力。内部测试版本显示,新一代Siri已具备解析复杂语境的智能,可同时执行跨应用的多步骤操作。

在典型应用场景中,用户无需分步下达指令即可完成复杂操作。例如发出"查看下周三会议安排,若与客户见面则取消健身课程并通知教练"的语音指令时,新版Siri能自动解析任务逻辑,依次完成日程查询、日历修改和消息发送三个动作。这种突破性改进标志着苹果在语音交互领域开始追赶ChatGPT等生成式AI的体验标准。

技术实现层面,苹果采用双引擎架构推进此次升级。通过与谷歌签订的长期技术合作协议,Siri的云端处理将深度整合Gemini大语言模型,该模型专门负责自然语言理解、任务拆解和逻辑推理等核心功能。与此同时,苹果自研的Apple Foundation Models持续优化设备端处理能力,重点保障用户隐私数据在本地完成分析处理,形成"云端智能+端侧安全"的混合技术方案。

生态开放成为本次升级的另一重点。即将发布的iOS 27系统将首次开放Siri扩展接口,允许第三方AI服务通过标准化协议实现深度集成。除现有的ChatGPT接入外,谷歌Gemini、Anthropic Claude等主流模型都将获得系统级支持。更值得关注的是,苹果正在开发独立的Siri应用,采用气泡式对话界面设计,不仅支持历史记录查询,还将通过App Store构建AI插件生态系统。

这种开放策略为苹果开辟了新的商业模式。知情人士透露,通过Siri调用的第三方AI服务订阅将纳入App Store分成体系,这将成为继应用分发、内容订阅之后,苹果服务业务的重要增长点。按照开发计划,新一代Siri的技术细节和开发者工具包将于6月全球开发者大会正式发布,首批测试版本将同步向注册开发者推送。