在数据中心人工智能芯片领域,英伟达与AMD长期占据主导地位,但高通正以积极姿态切入这一赛道。2025年10月,高通宣布推出面向数据中心场景的新一代AI推理芯片Qualcomm AI200和A250,同步推出基于这两款芯片的加速卡及机架级解决方案。尽管新品尚未大规模商用,但高通在数据中心AI芯片领域的布局已引发行业关注。

沙特AI企业Humain近日披露,其数据中心已接收高通交付的全栈式AI机架解决方案。这些搭载AI100芯片的机架正在安装调试,首期将部署1024张AI加速器,成为高通全球范围内规模最大的AI加速器部署项目之一。该数据中心的首个客户为Adobe,双方合作聚焦于大规模推理及边缘到云的混合AI应用场景。此次部署标志着高通数据中心AI芯片首次实现大规模商用落地。

Humain首席执行官Tareq Amin在社交平台透露,项目核心目标包括构建可扩展的边缘智能体系、降低系统延迟并实现实时数据处理。他特别感谢高通总裁兼CEO Cristiano R. Amon及Adobe首席执行官Shantanu Narayen对项目的支持,强调三方合作展现了"目标明确、行动迅速"的决策效率。

追溯技术渊源,此次部署的AI100芯片实为高通2019年发布的产品。该芯片采用7纳米制程工艺,AI算力达100TOPs,是同期骁龙855移动平台的50倍。其软件系统支持TensorFlow等主流AI框架,但受限于当时的技术条件,Ultra版本仅配备128GB内存,单芯片仅能运行320亿参数规模的大模型。从当前视角审视,这款六年前面世的产品在性能参数上已显落后。

行业分析师指出,Humain选择AI100芯片主要基于两方面考量:其一是成本优势,作为已上市多年的产品,AI100在价格上具有显著竞争力;其二是供应稳定性,当前市场热门AI芯片被OpenAI、甲骨文等云服务商大量采购,导致供应链紧张,中小规模企业难以获取充足货源。对于以图像处理为核心需求的Adobe而言,AI100的算力已能满足基础图像填充与生成任务。

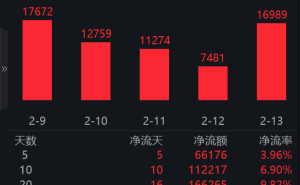

值得关注的是,Humain与高通的战略合作已进入深化阶段。双方于2025年13日签署谅解备忘录,计划共同开发下一代人工智能数据中心基础设施及云边协同服务。根据产品路线图,高通最新发布的AI200芯片需等到2026年上市,性能更强的AI250则要推迟至2027年。这种时间差或许解释了Humain为何选择现阶段部署AI100——在等待新一代产品成熟的过程中,通过现有解决方案快速建立市场优势。